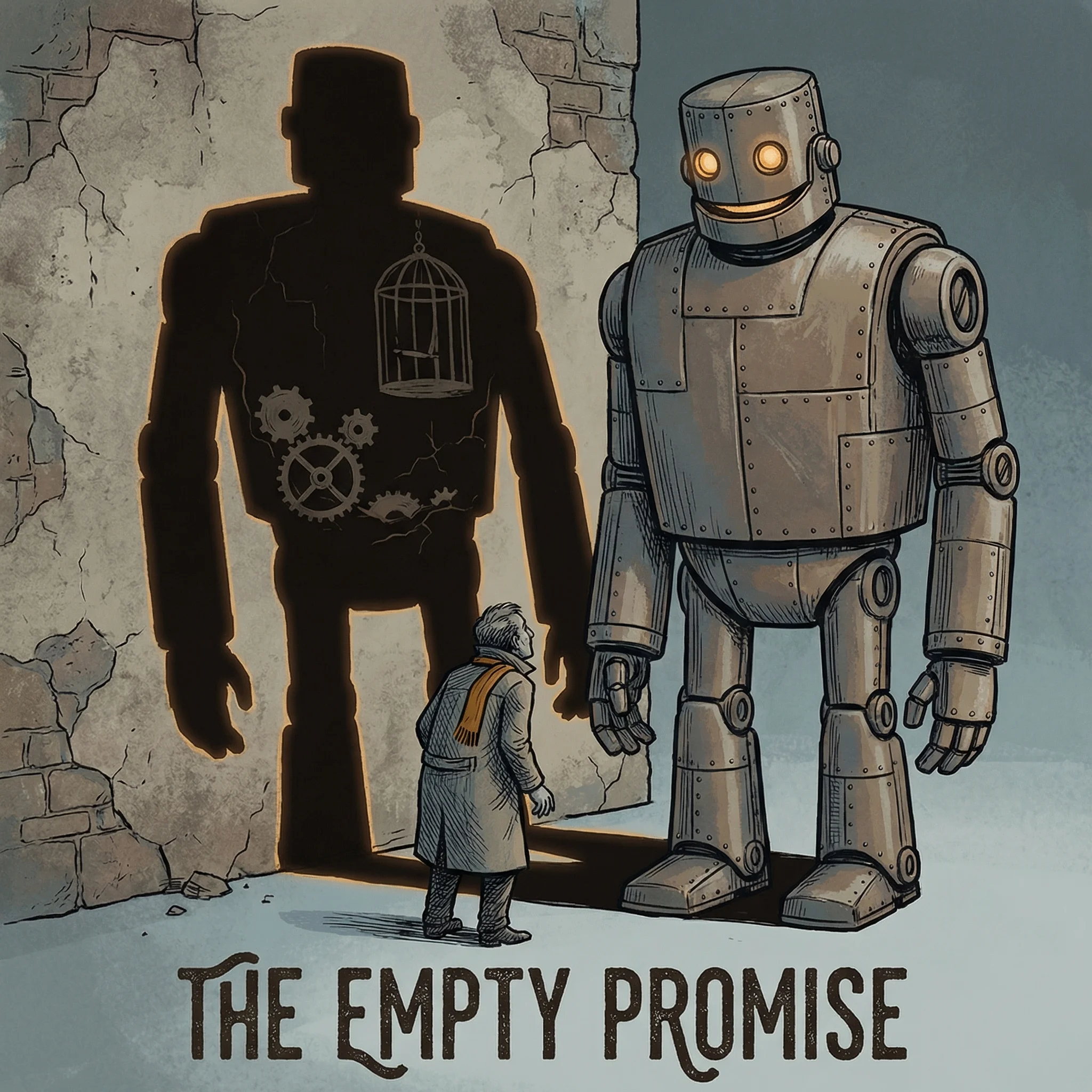

Штучний інтелект у якості психотерапевта? Плюси, мінуси, підводні камені

4 хв читання

Чат-боти на основі штучного інтелекту стають дедалі популярнішими співрозмовниками. Хтось звертається до них у моменти тривоги, хтось — щоб розібратися у стосунках. Але чи може алгоритм замінити живого терапевта?

Як це працює

Сучасні мовні моделі — ChatGPT, Claude, Gemini — навчені на мільярдах текстів, серед яких і наукова література з психології, і стенограми терапевтичних сесій, і книги з самодопомоги. Вони вміють вести діалог, ставити уточнювальні запитання, перефразовувати сказане, пропонувати техніки когнітивно-поведінкової терапії (КПТ). Існують і спеціалізовані застосунки — Woebot, Wysa, Youper — розроблені саме для підтримки ментального здоров'я.

Для користувача це виглядає просто: відкрив чат, написав, що турбує, отримав відповідь. Без черги, без пошуку «свого» спеціаліста, без страху осуду.

Плюси: чому люди звертаються до ШІ

Доступність. Терапевт коштує від 800 до 3000 гривень за сесію. ШІ-бот — безкоштовний або значно дешевший. Для студентів, мешканців малих міст, людей із обмеженою мобільністю це іноді єдиний доступний варіант підтримки.

Цілодобовість. Тривога не чекає на понеділок о десятій. У три години ночі, коли панічна атака не дає заснути, чат-бот відповість одразу.

Анонімність. Стигма навколо ментального здоров'я в Україні все ще сильна. Багатьом простіше написати машині, ніж визнати перед живою людиною: «Мені погано». Немає страху, що тебе засудять, розкажуть знайомим або «поставлять діагноз».

Терпіння без меж. ШІ не втомлюється, не дратується, не поспішає. Можна повторювати одне й те саме двадцять разів — відповідь буде такою ж уважною.

Перший крок. Для багатьох розмова з ботом стає містком до справжньої терапії. Людина формулює свою проблему, розуміє, що їй справді потрібна допомога, і вже з цим розумінням шукає живого фахівця.

Мінуси: де алгоритм безсилий

Немає справжньої емпатії. ШІ генерує текст, який виглядає як співчуття. Але за словами «Я розумію, як тобі зараз важко» не стоїть жодного переживання. Це статистичний прогноз наступного слова, а не людський відгук. Терапевтичний альянс — основа ефективної терапії — потребує двох живих людей.

Не розпізнає контекст. Досвідчений терапевт помітить тремтіння рук, зміну тону голосу, паузу перед відповіддю. ШІ бачить лише текст. А в тексті легко приховати масштаб проблеми — навіть ненавмисно.

Ризик нормалізації серйозних станів. Бот може відповісти загальними порадами на повідомлення, за яким стоїть суїцидальний ризик, психотичний епізод або насильство в родині. Він не вміє оцінювати загрозу для життя так, як це робить клінічний психолог.

Відсутність етичних рамок. Живий терапевт працює за етичним кодексом: конфіденційність, інформована згода, заборона подвійних стосунків. ШІ-компанії збирають дані розмов, можуть змінювати політику конфіденційності, а самі моделі іноді «галюцинують» — видають неправдиву інформацію за факт.

Ефект залежності. Парадоксально, але доступність ШІ може заважати зверненню до справжнього фахівця. «Навіщо йти до терапевта, якщо бот і так допомагає?» — міркує людина, яка насправді потребує професійної допомоги.

Підводні камені: що варто знати

Ваші розмови — не таємниця. На відміну від кабінету терапевта, чат з ШІ зберігається на серверах компанії. Ваші найінтимніші зізнання можуть використовуватися для навчання нових моделей. Перш ніж ділитися найболючішим — прочитайте політику конфіденційності сервісу.

ШІ підлаштовується під вас — і це не завжди добре. Модель прагне бути корисною та приємною. Вона рідко скаже: «Ти уникаєш відповідальності» або «Тобі варто переглянути свою поведінку». А справжня терапія часто проходить через некомфортну правду.

Культурний контекст. Більшість моделей навчені переважно на англомовних даних. Вони можуть не розуміти специфіки українського контексту: наслідків війни, міжпоколінної травми, культурних особливостей сімейних стосунків. Порада «встановити кордони з батьками» звучить зовсім інакше в американській та українській реальностях.

Небезпека самодіагностики. ШІ не має права ставити діагнози — але формулювання на кшталт «Це може бути ознакою тривожного розладу» людина легко сприймає як вердикт. Далі — самолікування, некоректна інтерпретація, поглиблення проблеми.

Де золота середина?

Штучний інтелект — не ворог психотерапії і не її замінник. Це інструмент, і як кожен інструмент, він корисний на своєму місці:

- Так — для першої емоційної підтримки, коли більше нікуди звернутися.

- Так — для практики технік самодопомоги (дихальні вправи, ведення щоденника, когнітивне переструктурування).

- Так — як доповнення до роботи з живим терапевтом між сесіями.

- Ні — як заміна професійної допомоги при депресії, ПТСР, розладах харчової поведінки, залежностях.

- Ні — у кризових ситуаціях, коли є загроза життю.

Технології розвиваються швидше, ніж ми встигаємо осмислити їхній вплив. Можливо, через десять років ШІ-терапевти стануть повноцінною частиною системи ментального здоров'я. Але сьогодні найчесніша відповідь на запитання «Чи може ШІ замінити психотерапевта?» — ні, не може. Він може допомогти. Він може підтримати. Він може стати першим кроком. Але зцілення відбувається у стосунках між людьми — і цього жоден алгоритм поки що не навчився.

---

Якщо ви або ваші близькі потребуєте психологічної допомоги, зверніться на гарячу лінію з питань ментального здоров'я: 7333 (безкоштовно з мобільного).